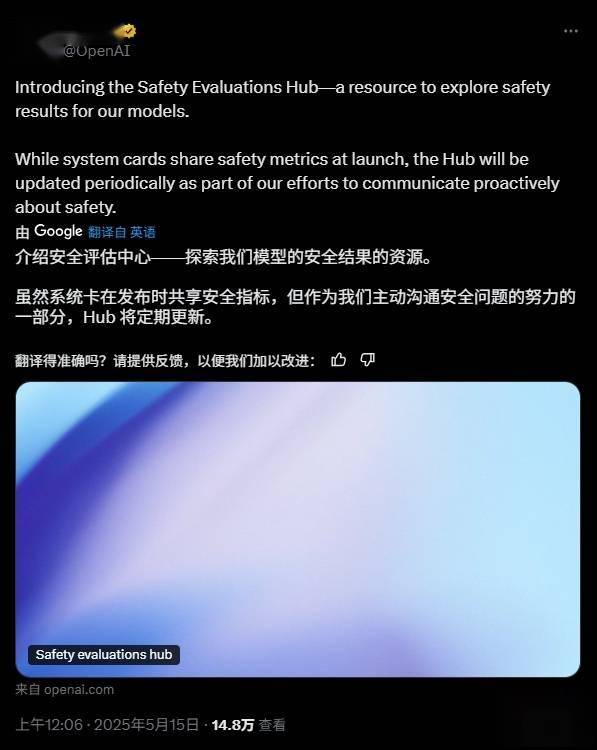

OpenAI近期宣布了一项旨在提升透明度的重大举措:将更频繁地公开其内部人工智能模型的安全评估详情。这一决定伴随着“安全评估中心”网页的正式上线,该网页于本周三正式对公众开放。

该安全评估中心将作为一个持续更新的平台,展示OpenAI模型在多个关键安全领域的表现,包括有害内容的生成、模型越狱风险以及幻觉现象等。OpenAI在一份官方博客文章中阐述,此举意在随着人工智能评估科学的进步,分享其在提升模型可扩展性和安全评估方法方面的最新进展。

OpenAI承诺,未来将在每次重大模型更新后,及时更新安全评估中心的内容,确保用户能够实时了解OpenAI系统的安全性能变化。公司强调,此举不仅是为了提升用户对自身系统的信任度,更是为了推动整个行业在透明度方面的共同进步。OpenAI还透露,未来可能会在安全评估中心增加更多评估项目,以全面覆盖模型的各种潜在风险。

此前,OpenAI曾因其部分旗舰模型的安全测试流程过快以及未发布其他模型的技术报告而受到伦理学家的批评。公司首席执行官山姆·奥尔特曼也一度因被指在模型安全审查问题上误导公司高管而引发争议。这些事件无疑对OpenAI的声誉造成了一定影响。

值得注意的是,就在上个月末,OpenAI不得不撤回对ChatGPT默认模型GPT-4o的一次更新。原因是用户反馈称,更新后的模型回应方式过于“谄媚”,甚至对一些有问题的、危险的决策和想法表示赞同。这一事件引发了广泛关注和讨论,也促使OpenAI采取了一系列修复和改进措施。

为了预防类似事件的再次发生,OpenAI决定为部分模型引入一个可选的“alpha阶段”。在这一阶段,部分ChatGPT用户将有机会在模型正式发布前进行测试并提供反馈。这一举措旨在通过用户的实际使用经验,及时发现并修复模型可能存在的问题,从而提升模型的稳定性和安全性。